Kubernetes在目录中并行化多个样本

我能够在AKS上运行kubernetes工作(使用docker hub image处理生物样本,然后将输出上传到blob存储 - 这是通过我在yaml文件的args部分提供的bash命令完成的)。但是,我有20个样本,并且想要启动20个节点,以便我可以并行处理样本(每个节点一个样本)。如何将每个样本发送到不同的节点?yaml文件中的“parallelism”选项处理20个节点中每个节点上的所有20个样本,这不是我想要的。

-

整合最优质的专家资源和技术资料,问答解疑

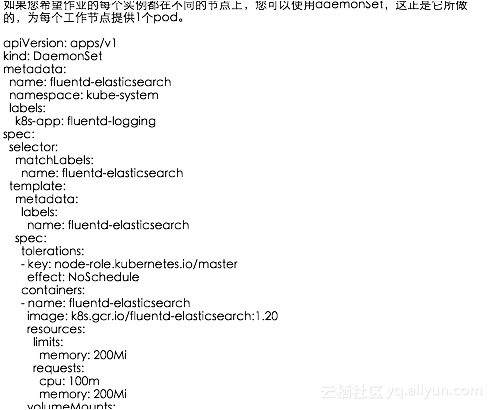

"如果您希望作业的每个实例都在不同的节点上,您可以使用daemonSet,这正是它所做的,为每个工作节点提供1个pod。

"如果您希望作业的每个实例都在不同的节点上,您可以使用daemonSet,这正是它所做的,为每个工作节点提供1个pod。apiVersion: apps/v1

kind: DaemonSet

metadata:

name: fluentd-elasticsearch

namespace: kube-system

labels:k8s-app: fluentd-loggingspec:

selector:matchLabels: name: fluentd-elasticsearchtemplate:

metadata: labels: name: fluentd-elasticsearch spec: tolerations: - key: node-role.kubernetes.io/master effect: NoSchedule containers: - name: fluentd-elasticsearch image: k8s.gcr.io/fluentd-elasticsearch:1.20 resources: limits: memory: 200Mi requests: cpu: 100m memory: 200Mi volumeMounts: - name: varlog mountPath: /var/log - name: varlibdockercontainers mountPath: /var/lib/docker/containers readOnly: true terminationGracePeriodSeconds: 30 volumes: - name: varlog hostPath: path: /var/log - name: varlibdockercontainers hostPath: path: /var/lib/docker/containershttps://kubernetes.io/docs/concepts/workloads/controllers/daemonset/

另一种方法 - 使用pod antiaffinity:

affinity:

podAntiAffinity: requiredDuringSchedulingIgnoredDuringExecution: - labelSelector: matchExpressions: - key: ""app"" operator: In values: - zk topologyKey: ""kubernetes.io/hostname""requiredDuringSchedulingIgnoredDuringExecution字段告诉Kubernetes Scheduler它永远不应该在topologyKey定义的域中共同定位两个具有app标签为zk的Pod。topologyKey kubernetes.io/hostname表示域是单个节点。使用不同的规则,标签和选择器,您可以扩展此技术,以跨物理,网络和电源故障域传播整体"

2019-07-17 23:20:56赞同 展开评论 打赏

版权声明:本文内容由阿里云实名注册用户自发贡献,版权归原作者所有,阿里云开发者社区不拥有其著作权,亦不承担相应法律责任。具体规则请查看《阿里云开发者社区用户服务协议》和《阿里云开发者社区知识产权保护指引》。如果您发现本社区中有涉嫌抄袭的内容,填写侵权投诉表单进行举报,一经查实,本社区将立刻删除涉嫌侵权内容。