云栖号资讯:【点击查看更多行业资讯】

在这里您可以找到不同行业的第一手的上云资讯,还在等什么,快来!

一位程序员小哥,正在Facebook食堂愉快地准备喝咖啡。

突然,就被水淹了。

而另一位正好好坐着玩手机的同学,则猝不及防地遭遇了屋顶漏雪事件。

不过几秒钟的时间,不仅头发上覆上了一层雪,脚面都被积雪埋住了。

遭遇“灵异事件”的还有一只无辜的小猫咪。

它本乖乖坐在小桌板上专心卖萌,房间却突然暗了下来,还有奇怪的小光球开始绕着它转圈圈!

当事猫表示:当时我心里害怕极了。

看着受害猫惊(dan)慌(ding)的表情,兼此事件一时引得物议沸腾:

我们决定:走进科学。

而当我们剥开事实的真相,发现,这一切事件的“始作俑者”竟是——

来自华盛顿大学和Facebook的最新单目深度估计算法,已中SIGGRAPH 2020,将于下周在GitHub上开源。

单目视频深度估计

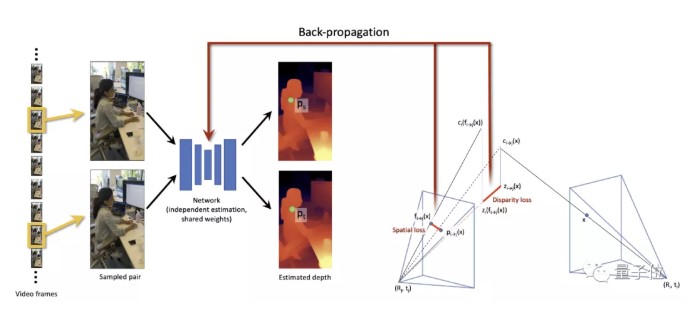

算法的核心思路,是结合单图像深度估计网络和传统的结构-运动重建法,使网络学会为指定视频生成几何一致的深度。

该方法整体设计架构如下。

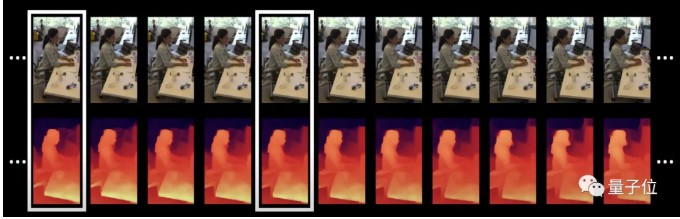

输入单目视频,对一对相机位置不同的帧进行采样,然后,用预先训练好的单图像深度估计模型估计深度,得到初始深度图。

对这对图像,使用光流法前后向一致性检查建立对应关系。

接着,利用这些对应关系和相机位置提取三维几何约束。

将三维几何约束分解为两个损失:

- 空间损失

- 视差损失

通过标准反向传播,用这两个损失对深度估计网络的权重进行微调,以最小化多帧几何不一致性误差。

如此,只需要对视频中任意帧进行配对采样,就可以将这一过程扩展到整个视频,对单目视频中的所有像素进行几何一致的深度重建。

在研究人员的实验中,对于一个244帧的视频,用4个英伟达Tesla M40 GPU训练下来需要40分钟。

超过此前SOTA,各个数据集上表现稳定

在评估深度重构方法方面,已经有了很多数据集。

但论文作者认为,这些数据集或多或少存在一些问题——要么是合成的,要么是针对自动驾驶等特定领域的,要么是针对单幅图像或静态场景的视频的,并不能完美地评估他们方法有效性。

于是他们用手持摄像机做了一个自定义3D数据集,来进行评估。数据集由静态和物体运动量很小的动态场景组成,视频的分辨率为1920x1440像素,长度从119帧到359帧不等。

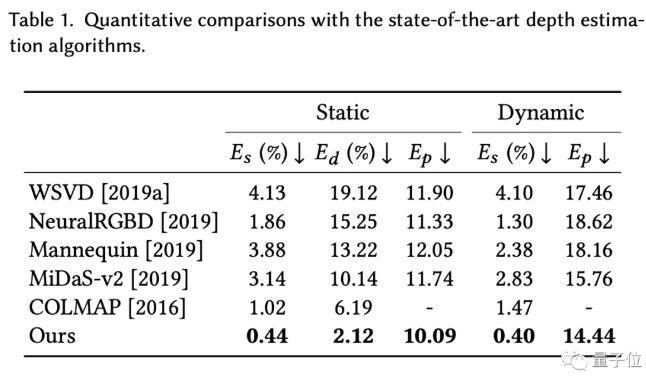

对比的对象是此前最先进的深度估计模型:传统的多视角立体视觉系统COLMAP、单图像深度估计模型Mannequin Challenge和MiDaS-v2、基于视频的深度估计模型WSVD(两帧)和 NeuralRGBD(多帧)。

评估的指标一共有三个,覆盖模型的“测光误差”(Es)、“(不)稳定性”(Ed)、“漂移程度”(Ep),都是反向指标,数值越小,证明模型效果更好。

从下图中可以看出,无论是静态场景还是动态场景,论文中提出的深度估计算法,在各个指标上都是最优。

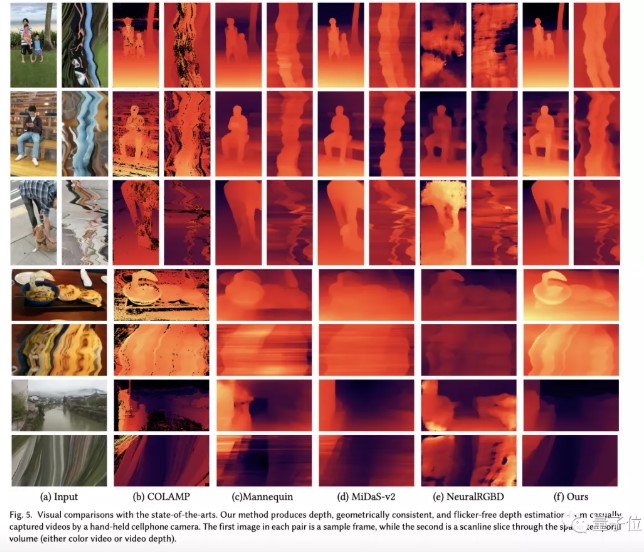

从直观的结果中也能够看出效果的差异:

不仅精度和几何一致性更高,视觉效果也更加稳定。

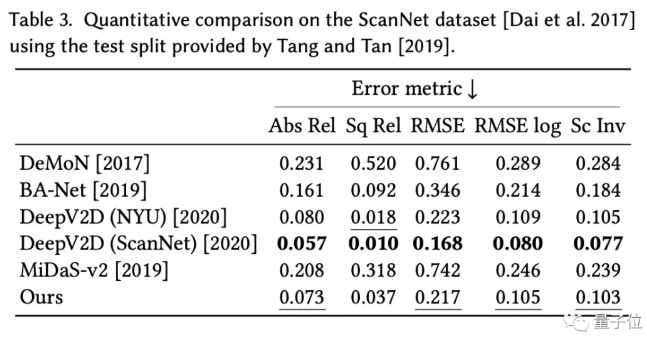

此外,为了评估的完整性与公平性,他们还在三个公开数据集上,与这些模型进行了定量比较,分别是:TUM数据集、ScanNet数据集和KITTI 2015数据集。

下表展示的是ScanNet数据集上结果,论文中提出的方法虽然不是最优,但与最优算法的差距并不算大。

来自中国女学霸,本科毕业于上海交大

这一研究成果来自华盛顿大学、Facebook等研究机构,一共有5名学者参与。

一作名为罗璇,是华盛顿大学在读博士,2015年毕业于上海交大ACM班,是戴文渊等大神的直系学妹。

本科毕业之后,先后拿到加州伯克利大学、华盛顿大学等高校Offer,为了追求“虚拟视觉”而选择了华盛顿大学,这也是她从高中就开始关注的领域。

去华盛顿大学读博之后,她先后在迪士尼、谷歌等知名企业实习,当前的这一研究成果,是她在Facebook实习期间的研究成果。

第二作者是Jia-Bin Huang,弗吉尼亚理工学院助理教授,本科毕业于台湾国立交通大学。论文的其他三位作者, 都来自Facebook,分别是Richard Szeliski、Kevin Matzen、Johannes Kopf。

关于这一研究,他们在结论部分提到了不足之处——比较依赖此前的研究成果,比如用COLMAP估计单目视频中摄像机的姿态,依赖FlowNet2建立几何约束等等。

这些方法的不足,也直接影响到了罗璇等人的研究。

另一个值得改进的地方在于,它不支持在线处理,训练244帧的视频需要约40分钟,如果想要实际的生活中,还需要进一步优化。

但从广大网友的山呼海啸般的反响中,也能够看到算法一旦实现,用户是肯定有的~

你期待吗?

【云栖号在线课堂】每天都有产品技术专家分享!

课程地址:https://yqh.aliyun.com/live立即加入社群,与专家面对面,及时了解课程最新动态!

【云栖号在线课堂 社群】https://c.tb.cn/F3.Z8gvnK

原文发布时间:2020-05-03

本文作者:鱼羊 乾明

本文来自:“量子位公众号”,了解相关信息可以关注“公众号 QbitAI”