Linux Ubuntu 18.04实战安装大数据Hadoop 3.1.2版本。这里分别选择最新的Ubuntu系统 18.04,以及最新的Hadoop版本3.1.2

Hadoop是开源免费的大数据方案,官方网站https://hadoop.apache.org/,核心的组件都是使用Java开发,也是目前也是最流行的,使用最广泛的大数据解决方案,包括几十个框架和工具。

hadoop有3种模式,我们先使用最简单的模式,来安装实战学习Hadoop。

1)单机模式Local (Standalone) Mode

2)伪分布式Pseudo-Distributed Mode

3)完全分布式Fully-Distributed Mode

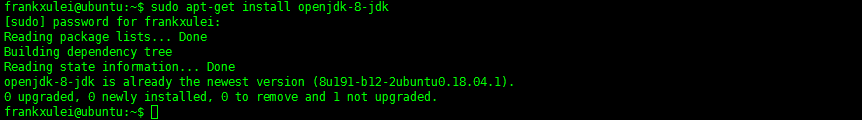

1、安装JDK

安装开源的JDK,免费,不会引起收费问题。

sudo apt install default-jdk

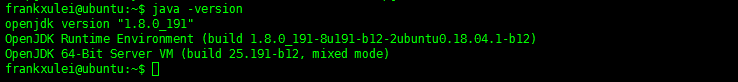

查看安装版本 Java -version

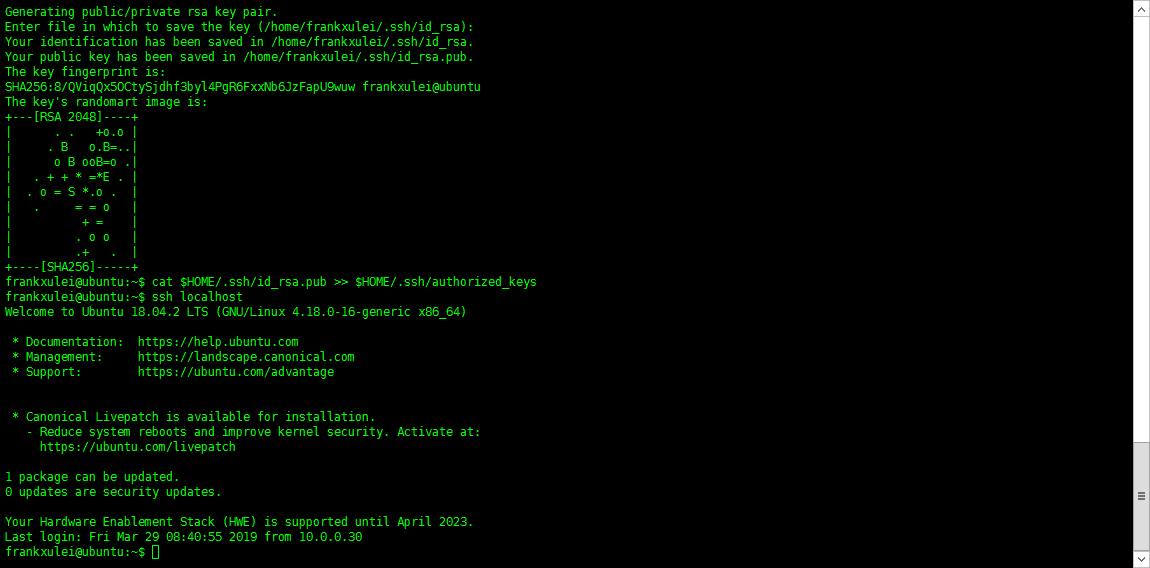

2、安装SSH

sudo apt-get install openssh-server openssh-client

ssh-keygen -t rsa -P ""

cat $HOME/.ssh/id_rsa.pub >> $HOME/.ssh/authorized_keys

测试登录,不需要密码:

ssh localhost

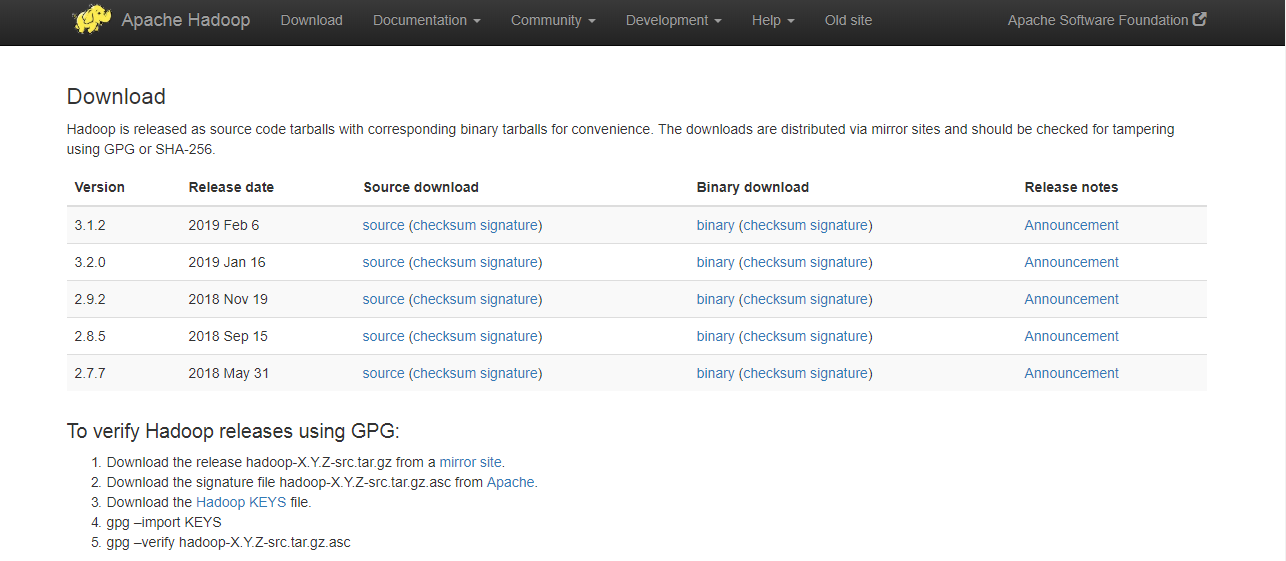

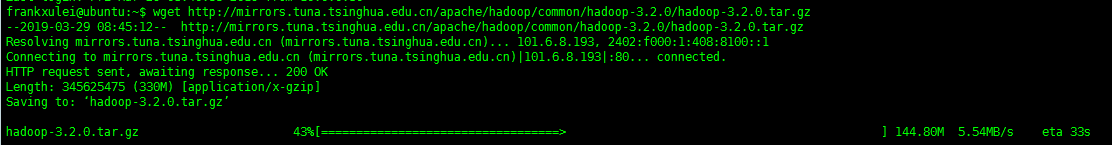

3、下载最新版本Hadoop

为了速度我们选择清华大学镜像,服务器,

wget http://mirrors.tuna.tsinghua.edu.cn/apache/hadoop/common/hadoop-3.1.2/hadoop-3.1.2.tar.gz

4、安装Hadoop

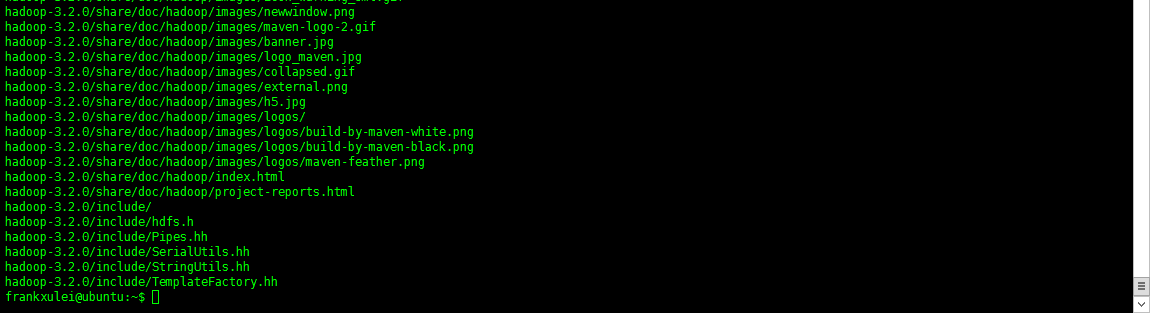

等待下载完毕,解压,然后进行安装配置

tar xzvf hadoop-3.1.2.tar.gz

mv hadoop-3.1.2 /usr/local/hadoop

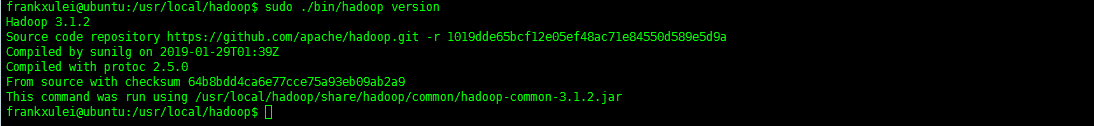

查看hadoop是否安装成功

sudo ./bin/hadoop version

5、创建Hadoop账号

为hadoop创建专用账户,并设置为超级用户

sudo addgroup hadoop

sudo adduser --ingroup hadoop hadoopuser

//加为超级用户

sudo adduser hadoopuser sudo6、配置Hadoop环境变量

在.bashrc文件中添加hadoop环境变量,使用下面的命令

sudo vim ./.bashrc然后塞入下面的配置,根据实际路径为准:

export HADOOP_HOME=/home/frankxulei/hadoop

export HADOOP_INSTALL=$HADOOP_HOME

export HADOOP_MAPRED_HOME=$HADOOP_HOME

export HADOOP_COMMON_HOME=$HADOOP_HOME

export HADOOP_HDFS_HOME=$HADOOP_HOME

export YARN_HOME=$HADOOP_HOME

export HADOOP_COMMON_LIB_NATIVE_DIR=$HADOOP_HOME/lib/native

export PATH=$PATH:$HADOOP_HOME/sbin:$HADOOP_HOME/bin使生效:

source ./.bashrc

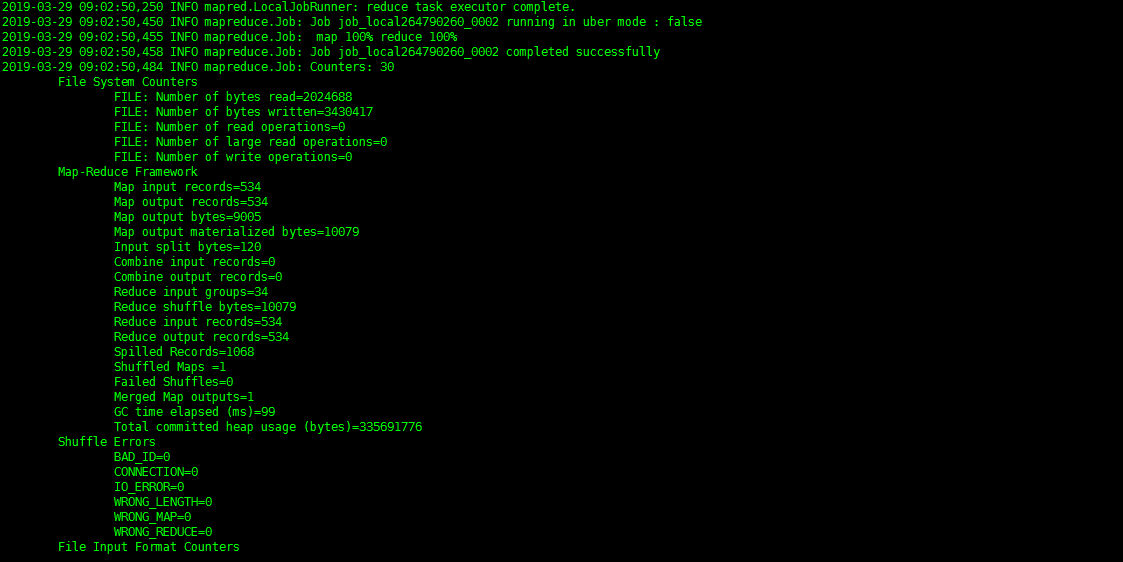

7、Hadoop测试例子

我们直接Hadoop自带的示例来测试单机模式是否正常工作。创建input目录,然后拷贝测试文本文件到input中,然后执行hadoop的Job分析结果。

本地创建input文件夹:

mkdir ~/input

拷贝测试数据文件到这个文件夹中:

cp /usr/local/hadoop/etc/hadoop/*.xml ~/input

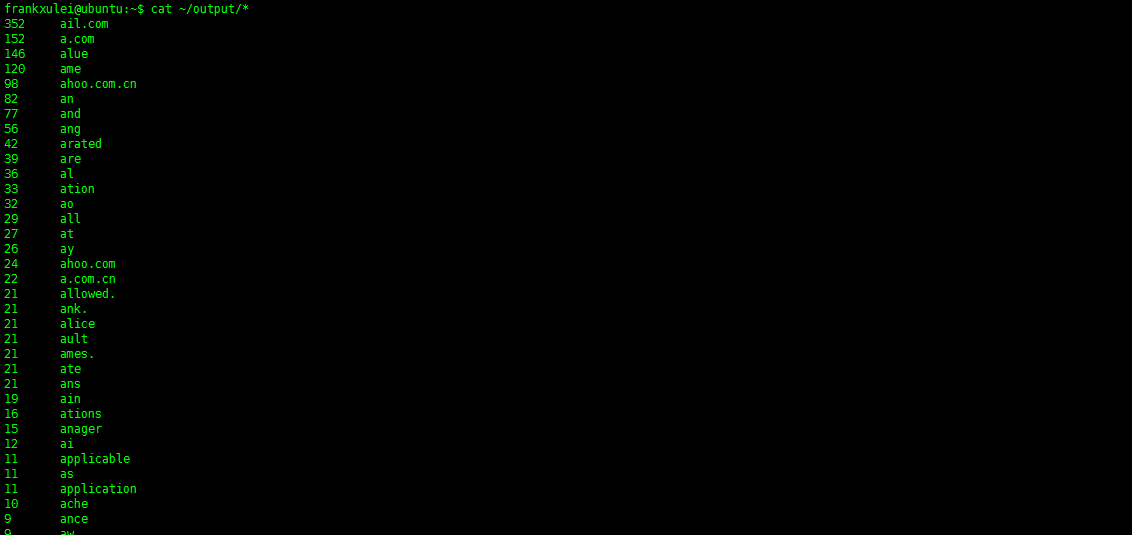

运行下面的命令,mapreduce分析出出a开头的单词频率

bin/hadoop jar /usr/local/hadoop/share/hadoop/mapreduce/hadoop-mapreduce-examples-3.1.2.jar grep ./input/ ./output 'a[a-z.]+'等待漫长的分析计算过程结束,你会看到hadoop不断输出日志信息,读取、清洗、统计结果

在输出目录上运行cat来检查大数据分析的结果如下:

cat ~/output/*结果信息安装不同的单词,频率倒序输出结果,如图所示,表示Hadoop分析过程成功执行

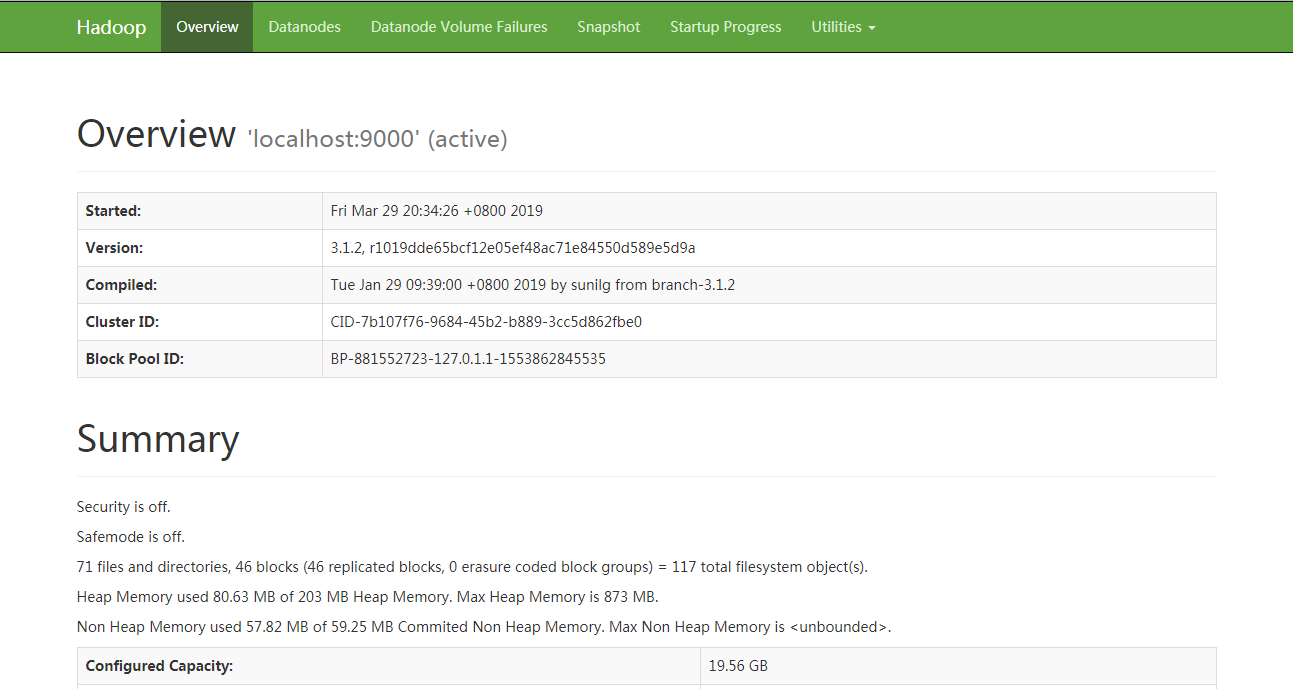

8、管理界面

启动Hadoop可以在http://localhost:9870地址,查看Hadoop服务运行状态信息

后续我们还有Hadoop集群模式,等复杂的实战配置。

阿里巴巴Java群超过4800人

进群方式:钉钉扫码入群

阿里巴巴MongoDB群

参考http://hadoop.apache.org/docs/stable/hadoop-project-dist/hadoop-common/SingleCluster.html#Fully-Distributed_Operation