Kubernetes 作为一个广受欢迎的开源容器协调系统, 是Google于2014年酝酿的项目。从Google趋势上看到,Kubernetes自2014年以来热度一路飙升,短短几年时间就已超越了大数据分析领域的长老Hadoop。本公众号之前的文章(Kubernetes核心组件解析)也对Kubernetes的几个组件做了一些详细的剖析,本文就带领大家一起看看Kubernetes和Spark碰到一起会擦出什么样的火花。

Spark2.3.0之前的版本只原生支持Standalone、YARN和Mesos三种部署模式,也就是说要迁移Spark2.3.0之前的Spark到Kuberbetes上,还得准备一层Standalone、YARN或者Mesos环境,不过Spark2.3.0已经引入了对Kubernetes的原生支持。

Spark2.3.0可以将编写好的数据处理程序直接通过spark-submit提交到Kubernetes集群,通过创建一个Drive Pod和一系列Executor Pods,然后共同协调完成计算任务,整体过程的官方示意图如下。

当我们通过spark-submit将Spark作业提交到Kubernetes集群时,会执行以下流程:

1. Spark在Kubernetes Pod中创建Spark Driver

2. Driver调用Kubernetes API创建ExecutorPods,Executor Pods执行作业代码

3. 计算作业结束,Executor Pods回收并清理

4. Driver Pod处于completed状态,保留日志,直到Kubernetes GC或者手动清理

Spark原生支持Kubernetes最大的好处是,不用在Kubernetes集群上再建立一层资源调度系统,只要建立一个新Spark容器镜像,并指派合适的RBAC权限角色,给所要执行的Spark应用程序,就可以在Kubernetes集群上运行Spark程序了。

接下来就介绍如何在一个Kubernetes上运行Spark程序。

1前提条件

(1) 我们测试的是Spark 2.3.0,由于Spark on Kubernetes任务提交后,实际上在集群中是以custom resources和custom controller的形式运行,所以我们需要一个1.7+版本的k8s集群,同时需要启动Kubernetes DNS和RBAC。

(2) Spark2.3.0版本的二进制包,下载链接https://archive.apache.org/dist/spark/spark-2.3.0/spark-2.3.0-bin-hadoop2.6.tgz

2 打包制作Spark镜像

(1) 解压并进入到解压后的Spark安装文件路径

$ tar -zxvf spark-2.3.0-bin-hadoop2.6

$ cd spark-2.3.0-bin-hadoop2.6

(2) 制作Spark基础镜像

-

使用Spark提供的docker-image-tool.sh脚本制作

$ ./bin/docker-image-tool.sh -r <repo> -t my-tag build

$ ./bin/docker-image-tool.sh -r <repo> -t my-tag push

-

使用docker build命令制作

(3) 查看镜像

$ docker images | grep registry/spark3 运行Spark官方例子

(1) 获取集群信息,确认Kubernetes master地址

$ kubectl cluster-info(2) 为Spark创建一个RBAC的role

$ kubectl create serviceaccount spark

$ kubectl create clusterrolebinding spark-role --clusterrole=edit --serviceaccount=default:spark --namespace=default

(3) 运行如下命令,向Kubernetes集群提交计算π值的例子

$/spark-2.3.0-bin-hadoop2.6/bin/spark-submit \

--master k8s://k8s-master\

--deploy-mode cluster \

--name spark-pi \

--class org.apache.spark.examples.SparkPi \

--conf spark.kubernetes.authenticate.driver.serviceAccountName=spark \

--conf spark.executor.instances=2 \

--conf spark.kubernetes.container.image=registry/spark:2.3.0 \

local:///opt/spark/examples/jars/spark-examples_2.11-2.3.0.jar

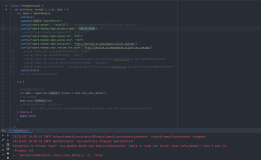

(4) 查看运行状态,计算π值的例子运行很快,可以看到它已经运行结束了

$ kubectl get po(5) 查看运行日志,可以看到π值已经计算出来了

$ kubectl logs -f spark-pi-63abb54cf382394d95413f43744c65ed-Drive至此,使用官方的例子体验Spark on Kubernetes就完成了。那么,如何提交自己编写的Spark程序到Kubernetes集群呢?

其实只需把自己写好的Spark程序编译成jar文件,然后打包到Spark基础镜像中,就可以提交到Kubernetes集群中运行了。

4 运行自己编写的Spark程序

(1)准备源代码。以一个wordcount程序为例。程序会从一个小说网站下载《了不起的盖茨比》的英文版小说,然后对其做词频统计,源代码如下:

import org.apache.commons.io.IOUtilsimport org.apache.spark.sql.functions._import java.net.URLimport org.apache.spark.sql.SparkSessionclass WordCount { def main(args: Array[ String]) { val spark = SparkSession .builder .appName("CopyData") .getOrCreate() import spark.implicits._ valbankText = spark.sparkContext.parallelize( IOUtils.toString ( newURL("http://novel.tingroom.com/novel_down.php?aid=319&dopost=txt") ).split("\n" )) bankText.flatMap(p=>{ val pattern = "[^a-zA-Z0-9-']".r val line = pattern.replaceAllIn(p," " ) line.split(" ") }).map((_,1 )).reduceByKey(_+_).sortBy(p=>p._2,false ).toDF("word","count"). where(length ('word)> 4).show }}

(2) 源代码编译为wordcount.jar文件,并编写Dockerfile文件,内容如下:

FROM registry/spark:2.3.0

RUN mkdir -p /opt/spark/jars

COPY wordcount.jar /opt/spark/jars

(3)wordcount.jar和DockerFlie文件放在同一路径下,并在该路径下运行docker bulid命令打包镜像:

$docker build -t registry/spark_wordcount:latest -f Dockerfile .

(4)使用如下命令将wordcount程序提交到Kubernetes集群:

/home/nsfocus/dengxincheng/spark-2.3.1-bin-hadoop2.6/bin/spark-submit \

--master k8s://192.168.19.13:6443\

--deploy-mode cluster \

--name wordcount \

--class example.wordcount.WordCount \

--conf spark.kubernetes.authenticate.driver.serviceAccountName=spark \

--conf spark.executor.instances=2 \

--conf spark.kubernetes.container.image=registry/spark_wordcount:latest \

local:///opt/spark/jars/wordcount.jar

(5)当任务运行完了之后,使用kubectl logs查看wordcount程序运行所对应drive pod内的日志,可以得词频最高的前20个词,如下图。

5总结

新版的Spark加入对Kubernetes的原生支持,统一了Spark程序在Kubernetes上所有工作负载的控制层,这样可以简化群集管理并提高资源利用率。总的来说,使用Kubernetes原生调度的Spark主要有以下优点:

原生资源调度:不再需要二级调度,直接使用Kubernetes原生的调度模块,实现与其他应用的混布;

资源隔离:任务可以提交到指定的namespace,这样可以复用Kubernetes原生的qouta限制,实现任务资源的限制;

用户自定义:用户可以在Spark基础镜像中打上自己的Application, 更加灵活和方便;

内容编辑:安全大数据分析实验室 邓新程 责任编辑:肖晴

往 期回顾

本公众号原创文章仅代表作者观点,不代表绿盟科技立场。所有原创内容版权均属绿盟科技研究通讯。未经授权,严禁任何媒体以及微信公众号复制、转载、摘编或以其他方式使用,转载须注明来自绿盟科技研究通讯并附上本文链接。

关于我们

绿盟科技研究通讯由绿盟科技创新中心负责运营,绿盟科技创新中心是绿盟科技的前沿技术研究部门。包括云安全实验室、安全大数据分析实验室和物联网安全实验室。团队成员由来自清华、北大、哈工大、中科院、北邮等多所重点院校的博士和硕士组成。

绿盟科技创新中心作为“中关村科技园区海淀园博士后工作站分站”的重要培养单位之一,与清华大学进行博士后联合培养,科研成果已涵盖各类国家课题项目、国家专利、国家标准、高水平学术论文、出版专业书籍等。

我们持续探索信息安全领域的前沿学术方向,从实践出发,结合公司资源和先进技术,实现概念级的原型系统,进而交付产品线孵化产品并创造巨大的经济价值。

本文转自掘金-Kubernetes助力Spark大数据分析