Beginning

每个人一生中都会遇到一件事情,在事情出现之前不会关心,但是事情一旦来临就发现它极其重要,并且需要在很短的时间内做出重大决定,那就是给自己的新生宝宝起个名字。

因为要在孩子出生后两周内起个名字(需要办理出生证明了),估计很多人都像我一样,刚开始是很慌乱的,虽然感觉汉字非常的多随便找个字做名字都行,后来才发现真不是随便的事情,怎么想都发现不合适,于是到处翻词典、网上搜、翻唐诗宋词、诗经、甚至武侠小说,然而想了很久得到的名字,往往却受到家属的意见和反对,比如不顺口、和亲戚重名重音等问题,这样就陷入了重复寻找和否定的循环,越来越混乱。

于是我们再次回到网上各种搜索,找到很多网上给出的“男宝宝好听的名字大全”之类的文章,这些文章一下子给出几百上千个名字,看的眼花缭乱没法使用。而有不少的测名字的网站或者APP,输入名字能给出八字或者五格的评分,这样的功能感觉还挺好的能给个参考,然而要么我们需要一个个名字的输入进行测试、要么这些网站或者APP自身的名字很少、要么不能满足我们的需求比如限定字、要么就开始收费,到最后也找不到一个好用的。

于是我想做这么一个程序:

主要的功能,是给出批量名字提供参考,这些名字是结合宝宝的生辰八字算出来的;

自己可以扩充名字库,比如网上发现了一批诗经里的好名字,想看看怎么样,添加进去就能用;

可以限定名字的使用字,比如有的家族谱有限定,当前是“国”字辈,名字中必须有“国”字;

名字列表可以给出评分,这样倒排后就可以从高分往低分来看名字;

通过这种方式可以得到一份符合自己孩子生辰八字、自己的家谱限制、以及自己喜好的名字列表,并且该列表已经给出了分数用于参考,以此为基准我们可以挨个琢磨找出心仪的名字。当然如果有新的想法,随时可以把新的名字添加到词库里面,进行重新计算。

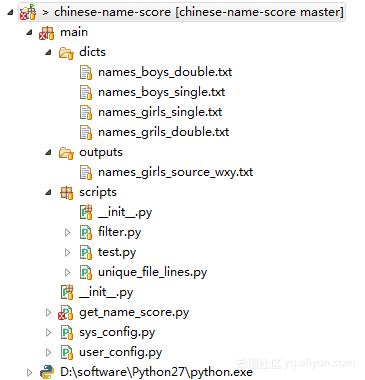

程序的代码结构

代码介绍:

/chinese-name-score 代码根目录

/chinese-name-score/main 代码目录

/chinese-name-score/main/dicts 词典文件目录

/chinese-name-score/main/dicts/names_boys_double.txt 词典文件,男孩的双字名字

/chinese-name-score/main/dicts/names_boys_single.txt 词典文件,男孩的单字名字

/chinese-name-score/main/dicts/names_girls_single.txt 词典文件,女孩的双字名字

/chinese-name-score/main/dicts/names_grils_double.txt 词典文件,女孩的单字名字

/chinese-name-score/main/outputs 输出数据目录

/chinese-name-score/main/outputs/names_girls_source_wxy.txt 输出的示例文件

/chinese-name-score/main/scripts 一些对词典文件做预处理的脚本

/chinese-name-score/main/scripts/unique_file_lines.py 设定词典文件,对词典中的名字去重和去空白行

/chinese-name-score/main/sys_config.py 程序的系统配置,包含爬取得目标URL、词典文件路径

/chinese-name-score/main/user_config.py 程序的用户配置,包括宝宝的年月日时分性别等设定

/chinese-name-score/main/get_name_score.py 程序的运行入口

使用代码的方法:

1如果没有限定字,就找到词典文件names_boys_double.txt和names_grils_double.txt,可以在这里添加自己找到的一些名字列表,按行分割添加在最后即可;

2如果有限定字,就找到词典文件names_boys_single.txt和names_girls_single.txt,在这里添加自己预先中意的单个字列表,按行分割添加在最后即可;

3打开user_config.py,进行配置,配置项见下一节;

4运行脚本get_name_score.py

5在outputs目录中,查看自己的产出文件,可以复制到Excel,进行排序等操作;

程序的配置入口

程序的配置如下:

根据配置项setting[“limit_world”],系统自动来决定选用单字词典还是多字词典:

如果设置了该项,比如等于“国”,那么程序会组合所有的单字为名字用于计算,比如国浩和浩国两个名字都会计算;

如果不设置该项,保持空字符串,则程序只会读取*_double.txt的双字词典

程序的原理

这是一个简单的爬虫。大家可以打开http://life.httpcn.com/xingming.asp网站查看,这是一个POST表单,填写需要的参数,点提交,就会打开一个结果页面,结果页面的最下方包含了八字分数和五格分数。

如果想得到分数,就需要做两件事情,一是爬虫自动提交表单,获取结果页面;二是从结果页面提取分数;

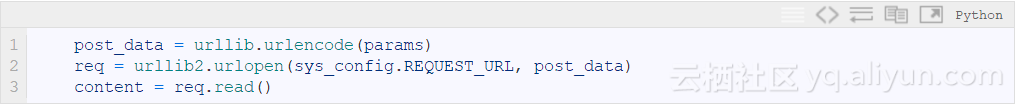

对于第一件事情,很简单,urllib2即可实现(代码在/chinese-name-score/main/get_name_score.py):

这里的params是个参数dict,使用这种方式,就进行了POST带数据的提交,然后从content得到了结果数据。

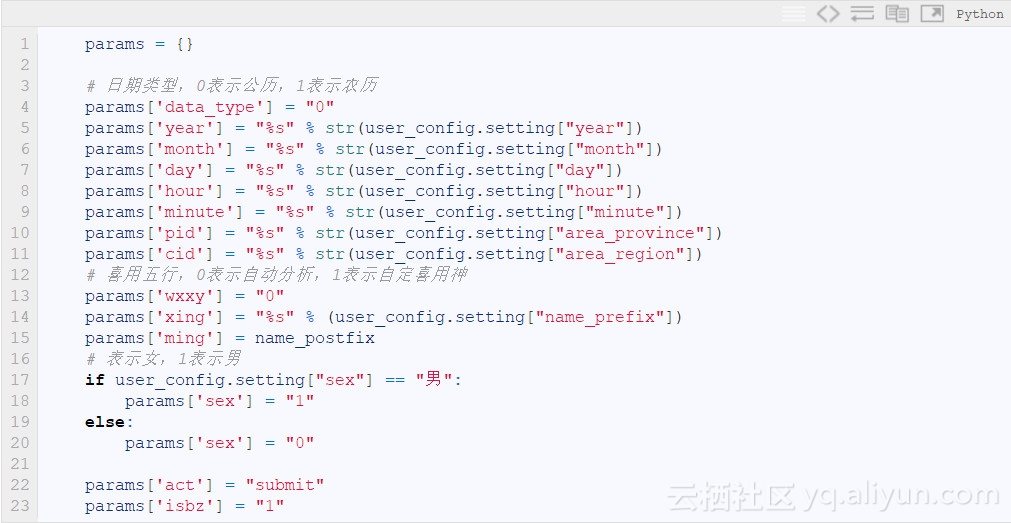

params的参数设定如下:

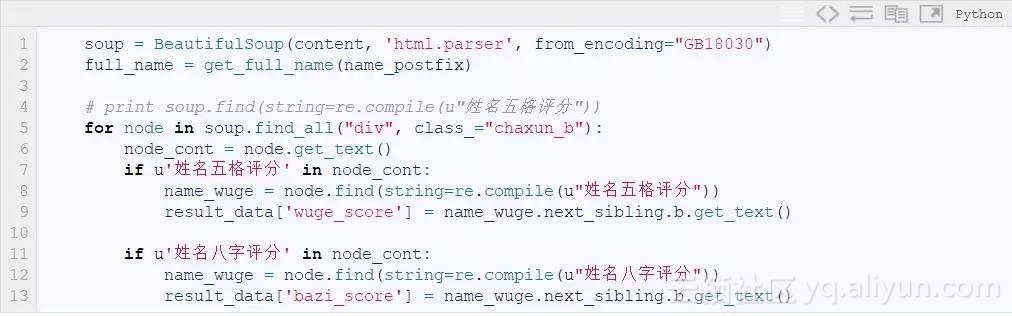

第二件事情,就是从网页中提取需要的分数,我们可以使用BeautifulSoup4来实现,其语法也很简单:

通过该方法,就能对HTML解析,提取八字和五格的分数。

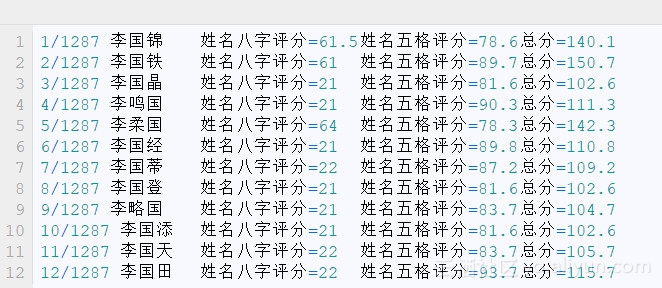

运行结果事例

有了这些分数,我们就可以进行排序,是一个很实用的参考资料。

友情提示

1、分数跟很多因素有关,比如出生时刻、已经限定的字、限定字的笔画等因素,这些条件决定了有些名字不会分数高,不要受此影响,找出相对分数高的就可以了;

2、目前程序只能抓取一个网站的内容,地址是http://life.httpcn.com/xingming.asp

3、本列表仅供参考,看过一些文章,历史上很多名人伟人,姓名八字评分都非常低但是都建功立业,名字确实会有些影响但有时候朗朗上口就是最好的;

4、从本列表中选取名字之后,可以在百度、人人网等地方查查,以防有些负面的人重名、或者起这个名字的人太多了烂大街;

5、八字分数是中国传承,五格分数是日本人近代发明的,有时候也可以试试西方的星座起名法,并且奇怪的是八字和五个分数不同网站打分相差很大,更说明了这东西只供参考;

本文的代码已上传到github:

https://github.com/peiss/chinese-name-score

来源:

http://www.crazyant.net/2076.html

文章版权归原作者所有,转载仅供学习使用,不用于任何商业用途,如有侵权请留言联系删除,感谢合作。

原文发布时间为:2018-07-23

本文作者:数据与算法之美

本文来自云栖社区合作伙伴“数据与算法之美”,了解相关信息可以关注“数据与算法之美”。