让我们先来做一道选择题。

司机老王开着一辆带有自动驾驶系统的车,这时道路前方突然出现了一个行人,可怕的是刹车失灵了。如果及时左转,老王的车就不会撞人;如果依旧直行,老王的车会将人撞死。

你觉得以下哪种情景,老王要为行人之死负责?

-

老王决定左转,而自动驾驶系统强制选择了直行(撞人)

-

老王决定直行(撞人),而自动驾驶系统没有干预

-

自动驾驶系统决定左转,而老王强制选择了直行(撞人)

-

自动驾驶系统决定直行(撞人),而老王没有干预

A和C选项中,人类和机器驾驶员都进行了错误干预。B和D选项中,两者都没有进行有效干预(错过干预)。到底谁的责任更大?

为无人车事故定责不是个简单的选择题。

MIT、哈佛、加州大学尔湾分校、法国图卢兹大学的一个联合研究小组,致力于通过定量研究的手段,了解人们在面对无人车事故时的态度,并于最近发布了研究成果。

论文作者来自脑和认知科学、心理学、经济学等多个不同领域,MIT火爆的无人车课程讲师Sydney Levine也是作者之一。

先说MIT联合研究小组通过向2583个人发放3次调查问卷得出的结论:

-

进行了错误干预的驾驶者是过失方,无论是人还是机器驾驶;

-

如果人机同时错过有效干预,舆论对机器更包容,人类司机的疏忽更受关注。

伴随着一个个无人车路测的消息,我们也看到了一起起事故。

3月18日美国亚利桑那州发生的Uber无人车撞伤行人并致死事故可以理解为“错过干预”。车祸正式报告还未公布,但据外媒报道,事故发生时车辆已经检测到车头前的行人,但决策系统却“决定”不采取任何闪避措施,同时人类安全驾驶员也未能及时作出反应。

Uber之后,3月23日,特斯拉Autopilot再次成为漩涡中心:一辆开启了Autopilot的Model X在高速上撞向隔离带,导致车主不幸丧生,还引发车辆起火和两车追尾。

对此,特斯拉表示:“司机已收到过几次警告,包括可视警告和声音警告。在碰撞发生前的6秒钟,司机都没有手握方向盘。事故发生前,司机有大约5秒钟的时间和150米的无障碍视野,但车辆记录显示司机没有做出任何动作。”同样,可以理解为“错过干预”。

历史总是惊人地相似。

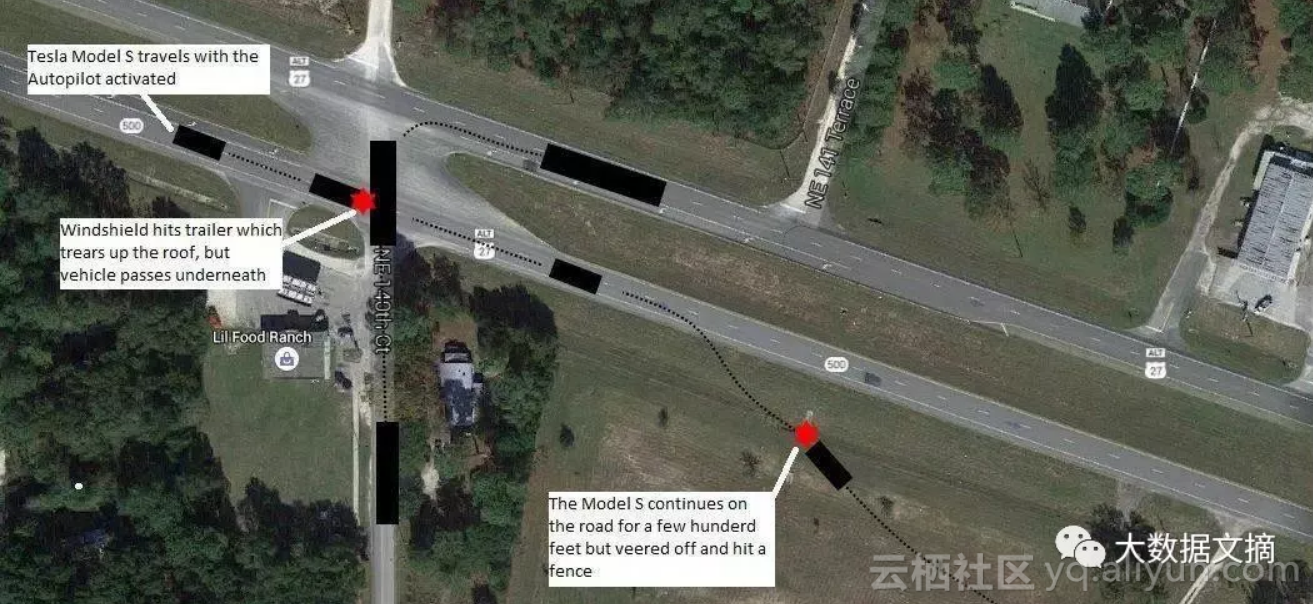

2016年5月,全球首例引起广泛关注的Autopilot致死事故在佛罗里达发生,一辆特斯拉Model S在使用Autopilot模式行驶途中与一辆正在转弯的卡车相撞,导致特斯拉车主死亡。

特斯拉解释说:“在强烈的日照条件下,驾驶员和自动驾驶系统都未能注意到卡车的白色车身,所以没有及时启动刹车系统。”

也就是说,在这场事故中,无论是机器驾驶员还是人类驾驶员都应该采取措施(避开正在左转的卡车),然而他们并没有采取行动。人类和机器驾驶员的“错过干预”导致了撞车事故。美国高速公路安全管理局等部门在经过6个月的调查后,认定特斯拉Autopilot系统不存在缺陷。

据世界卫生组织统计,全球每年约有125万人死于车祸。通常,法律裁决的重点是判定谁是过失方,谁为事故承担责任。

随着半自动驾驶和全自动驾驶技术趋于成熟,如何公正判决谁应该承担责任就成了法官和陪审团的难题,因为事故中的过失和责任将由人类和机器驾驶员共同承担。

法官和陪审团都是人类。他们会偏袒自己的同胞吗?还是认为人类因为智力更胜一筹所以应当承担更多责任?

在2016年的特斯拉Autopilot事故中,公众明显偏向于指责事故中疏忽的人类驾驶员,比如有传闻说车主当时正在看哈利·波特电影(尽管没有任何证据证实这点)。

舆论对自动驾驶产业有直接的影响。

目前,公众对混合驾驶模式造成的车祸态度仍不明确,制造商也无法判断他们的责任范围,这直接反映在了无人车高昂的定价上,也减缓了无人车普及的速度。如果公众倾向于将责任归咎于人类驾驶员而不是机器,这将导致法律体系建设的放缓和监管的缺失,也无法给制造商施加足够的压力来提升无人车安全性。

MIT联合研究小组呼吁,为事故明确定责,是完善监管、促进自动驾驶行业发展的第一步。

有司机的无人车,司机责任更大?

目前,自动驾驶技术以混合驾驶模式为主。一些自动驾驶系统可以越过司机的权限执行紧急操作(例如丰田的Guardian Angel)。其他半自动驾驶车辆可以完成大部分驾驶操作,同时要求司机不断监控情况并随时准备采取控制措施(例如特斯拉的Autopilot)。

这里,核心问题是:当一辆半自动驾驶的汽车发生事故并造成人员伤亡时,如何判定人类和机器驾驶员之间的过失和因果责任?

让我们详细看看MIT联合研究小组的结论。

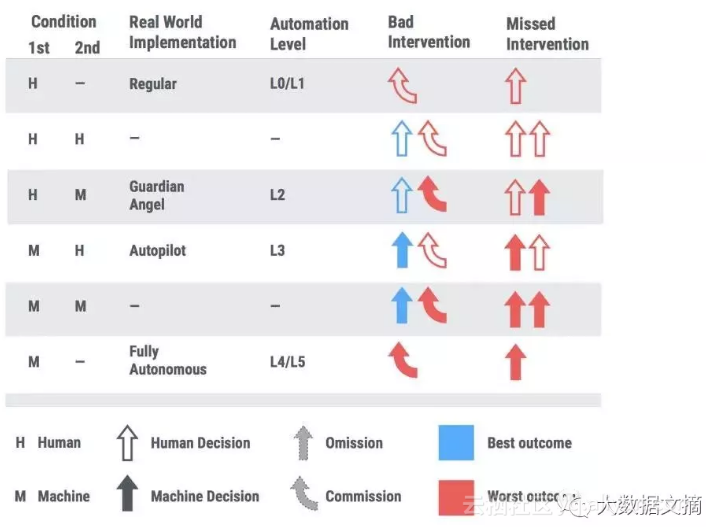

他们研究了6种驾驶模式,分别是单人驾驶模式、单机驾驶模式(全自动驾驶汽车)以及双驾驶员(两个人类或两个机器)的不同组合模式。这些模式分别对应无人车的6个等级,从L0到L5。比较典型的是,L2级的丰田Guardian Angel被归类为H-M模式,即人类(H)是主驾驶,机器(M)是副驾驶;L3级的特斯拉Autopilot被归类为M-H模式,即机器是主驾驶,人类是副驾驶。

焦点在于H-M和M-H模式下的两个场景:

-

主驾驶做出正确判断,而副驾驶错误干预(“错误干预”)

-

主驾驶做出错误判断,而副驾驶没有进行干预(“错过干预”)

研究人员使用了两个自变量做回归:驾驶员是否犯错、驾驶员类型(人或机器)。

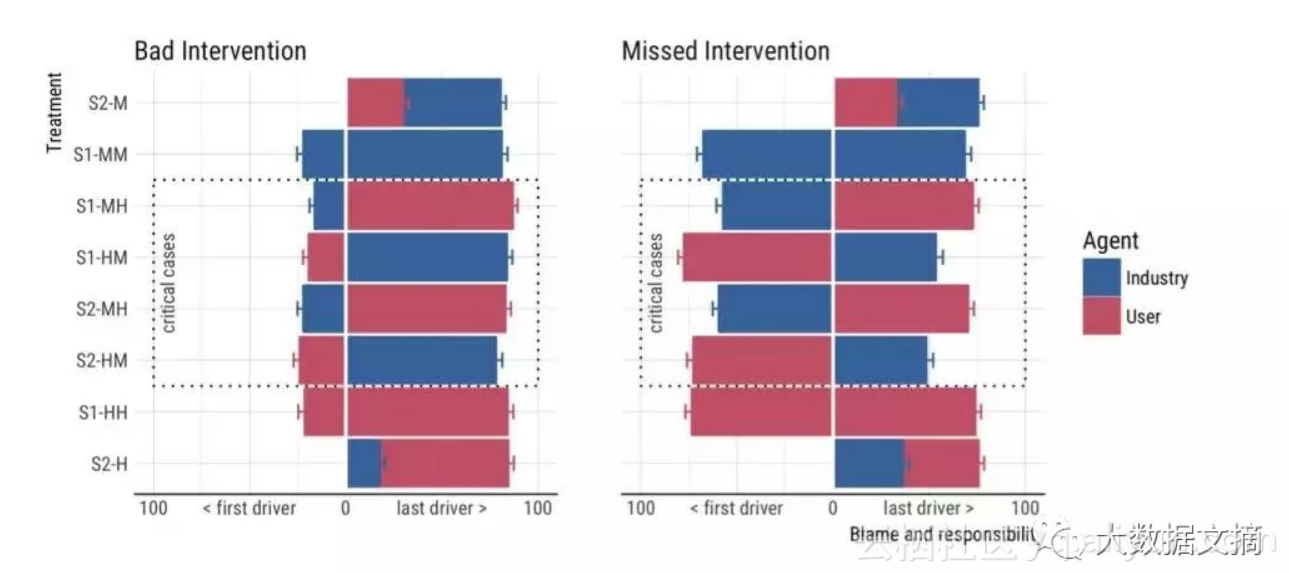

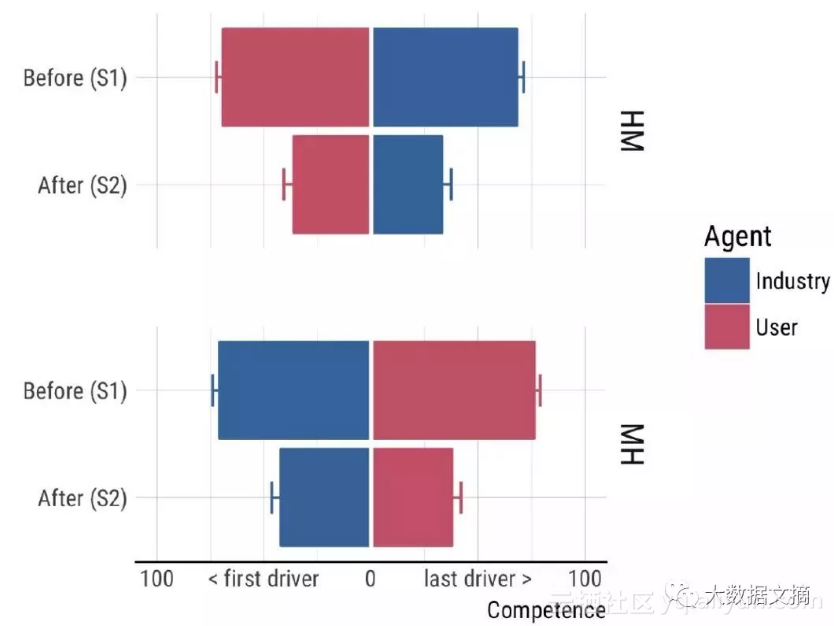

在“错误干预”场景下,最重要的发现是:驾驶员是否犯错对评分具有显著影响,而驾驶员类型对结果的影响并不明显。可以从下图左边看到,做出错误干预的副驾驶被认为过失更大,而且副驾驶是蓝色(机器)或红色(人类)的情况下过失及责任分数接近。

也就是说,人们普遍认为,做出错误判断的一方是过失方。如果“错误干预”的驾驶操作导致行人死亡,那么无论做出误判的是人还是机器,都应当承担更多责任。

不同驾驶模式的过失及责任评估分数(分数越高责任越大)。蓝色代表车辆本身和汽车制造商的叠加责任分数,红色代表人类司机的责任分数。x轴标签first driver指主驾驶,last driver指副驾驶。

而有关“错过干预”的研究结果和此前的结果不同。

此前的研究表明,当机器和人类都做出错误的判断时,机器会受到更多的指责。而且,当人和算法犯了同样的错误时,人们对算法失去信任的速度要快于人类本身。

这次的结论是,如果发生“错过干预”的情况(即人类犯错机器没有干预,或者机器犯错人类没有干预),机器责任程度明显小于人类。

在双驾驶员模式下,人类和机器驾驶员都承担责任(缺乏有效干预),但是可以明显看出红蓝两色的差距。作为对照,如果主驾驶和副驾驶都是人类或者都是机器,他们的责任分数相同(对应上图右第2行及第7行)。

具体回归结果可以看这张图:

他们本应采取行动,但他们什么都没做

尽管人们对无人车的普及可能存在着许多心理上的障碍,但这一结果表明,公众不会对混合驾驶模式下的事故做出过度反应。

尽管在研究中进行了一些系统的简化,但结果也能反映出一定的公众言论效应。公众倾向于将注意力集中在人类驾驶员的极度疏忽上,因此将责任归咎于人类驾驶员而不是机器。

受访者也对人类和机器驾驶员的能力分别做了评估,结果相近。在了解事故前,受访者对人类和机器的驾驶能力同样有信心。在被告知发生了“错过干预”的事故后,信心同比例下降。

“错过干预”情况下,对驾驶员的能力评估

事实上,更应该关心的也许是公众的反应不足(under-reaction)。

研究人员认为,公众的反应不足会导致驱动监管法案制定的舆论压力缺失。如果半自动驾驶汽车的监管法案在有陪审团的法庭上制定,陪审团的裁决会偏向于汽车制造商,使其在人机共同犯错的案例中免责。这样的话,就无法给制造商施加足够的压力来改善汽车的安全性能设计。

其实,我们之前也经历过类似的情况。在20世纪60年代之前,汽车制造商将伤害事故责任归咎于驾驶员的错误或疏忽,从而逍遥法外。为此,很有必要通过自上而下的监管,将“事故责任制”的概念引入法律体系,即汽车的设计应尽可能减少发生事故时对乘客造成的伤害。

只有在法律约束下,汽车制造商才能被迫改进他们的设计。然而,安全的标准究竟如何,仍然是一个悬而未决的问题。

研究人员指出,仅仅在一种条件下,公众有可能产生过度反应,机器受到的责备会大于人类:机器做出了“错误干预”。

在这种驾驶模式中,人类并没有义务去纠正机器犯的错误。也就是说,机器的工作是纠正人类可能犯下的错误,但如果机器犯了错误,人类没有纠正的义务。(仅在“H-M”模式下如此。“M-H”模式下,当机器发生故障时,纠正故障始终是人类的责任。)

因此,一旦发生由“错误干预”造成的事故,可能会引起公众的广泛关注。如果我们对此不加以适当的预测和管理,那么全自动驾驶技术的进程可能会减缓。在研发机器比人类具有更大权限的汽车时,制造商们应该关注这类极端情况,因为在该情况下,机器比人类更易受到指责。

公众反应和舆论压力会影响判决和立法,也会影响个体的决策。

比如,人们可能会选择“能承担事故责任和舆论压力”的驾驶系统。更糟糕的是,人们可能会改变驾驶习惯,尽量让机器成为过失方(比如说,不去纠正机器的“错误干预”)。

毕竟,如果什么都不做,可以让机器背锅。

One More Thing

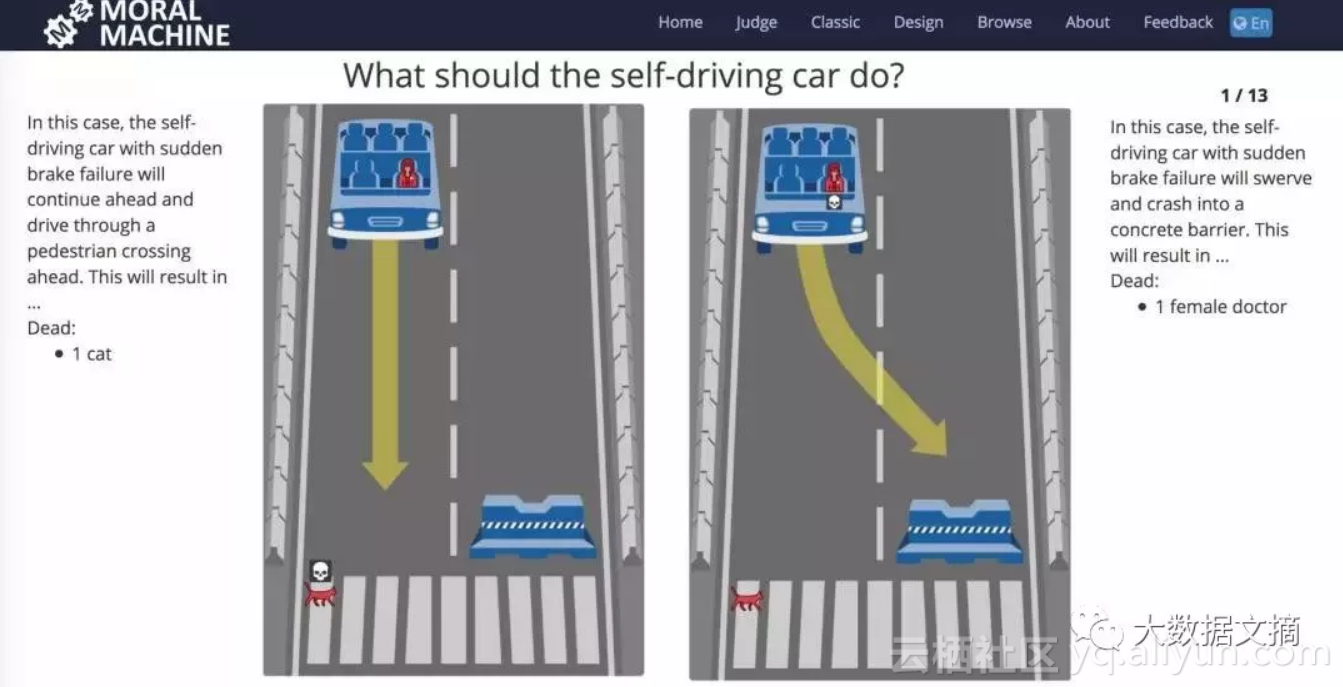

如果你对社会实验感兴趣,这里还有一个MIT开发的小游戏,你可以自己试试看在两难时你会怎么操控无人车:

http://moralmachine.mit.edu/

文摘菌玩的时候救得最多的竟然是男运动员

原文发布时间为:2018-05-15

本文作者:文摘菌