常用的负载均衡开源软件有: nginx、lvs、keepalived

商业的硬件负载设备: F5、Netscale

1、 LB、LVS介绍

LB集群是load balance 集群的简写,翻译成中文就是负载均衡集群;

LVS是一个实现负载均衡集群的开源软件项目;

LVS架构从逻辑上可分为调度层(Director)、server集群层(Real server)和共享存储层;

LVS可分为三种工作模式:

NAT(调度器将请求的目标ip即vip地址改为Real server的ip, 返回的数据包也经过调度器,调度器再把源地址修改为vip)

TUN(调度器将请求来的数据包封装加密通过ip隧道转发到后端的real server上,而real server会直接把数据返回给客户端,而不再经过调度器)

DR(调度器将请求来的数据包的目标mac地址改为real server的mac地址,返回的时候也不经过调度器,直接返回给客户端)

LVS的调度算法:轮叫调度(Round Robin)(简称rr) ,加权轮叫(Weighted Round Robin)(简称wrr),最少链接(least connection)(LC),加权最少链接(Weighted Least Connections)(WLC) 等等;

2、LVS/NAT 配置

准备工作:

需要准备三台机器干净的centos6.6系统,Director机器需要安装两块网卡;

三台服务器一台作为director, 两台作为real server

Director 有一个外网ip:192.168.22.11 和一个内网ip:192.168.11.11

两台Real Server 只有内网ip为:192.168.11.100 和 192.168.11.101,并且需要设置内网网关为director的内网ip:192.168.11.11

|

1

2

3

4

5

6

|

DEVICE=eth1

TYPE=Ethernet

ONBOOT=

yes

BOOTPROTO=static

IPADDR=192.168.11.100

GATEWAY=192.168.11.11

|

更改完网关后需要重启网卡,先down后up,在一条命令实现;如果ifdown之后,ssh会中断;

# ifdown eth1 && ifup eth1

Director上安装ipvsadm:#yum install -y ipvsadm

两台real server安装nginx,需要先安装epel扩展源。

yum install -y epel-release

yum install -y nginx

安装完成后启动nginx:/etc/init.d/nginx start

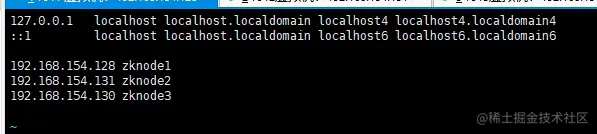

更改三台服务器的hostname为 dr、rs1、rs2

Direcotr 上 vi /usr/local/sbin/lvs_nat.sh //增加如下内容:

|

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

|

#! /bin/bash

echo

1 >

/proc/sys/net/ipv4/ip_forward

echo

0 >

/proc/sys/net/ipv4/conf/all/send_redirects

echo

0 >

/proc/sys/net/ipv4/conf/default/send_redirects

echo

0 >

/proc/sys/net/ipv4/conf/eth0/send_redirects

echo

0 >

/proc/sys/net/ipv4/conf/eth1/send_redirects

iptables -t nat -F

iptables -t nat -X

iptables -t nat -A POSTROUTING -s 192.168.11.0

/24

-j MASQUERADE

IPVSADM=

'/sbin/ipvsadm'

$IPVSADM -C

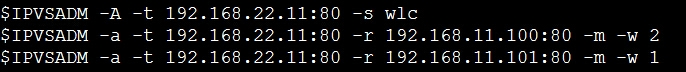

$IPVSADM -A -t 192.168.22.11:80 -s wlc

$IPVSADM -a -t 192.168.22.11:80 -r 192.168.11.100:80 -m -w 2

$IPVSADM -a -t 192.168.22.11:80 -r 192.168.11.101:80 -m -w 1

|

直接运行这个脚本就可以完成lvs/nat的配置了:

/bin/bash /usr/local/sbin/lvs_nat.sh

dr查看nat的iptables

|

1

2

3

4

|

[root@dr ~]

# iptables -t nat -nvL

Chain POSTROUTING (policy ACCEPT 1 packets, 124 bytes)

pkts bytes target prot opt

in

out

source

destination

0 0 MASQUERADE all -- * * 192.168.11.0

/24

0.0.0.0

/0

|

ipvsadm -ln 查看ipvsadm的规则

浏览器打开192.168.11.100、192.168.11.101显示nginx的欢迎页面

在rs1、rs2上面修改html文件,用来区分;

|

1

2

3

4

|

[root@rs1 ~]

# cat /usr/share/nginx/html/index.html

rs1rs1rs1

[root@rs2 ~]

# cat /usr/share/nginx/html/index.html

rs2rs2rs2

|

通过浏览器测试两台机器上的内容

浏览器打开 192.168.22.11,会显示rs1或rs2的html内容;来回切换说明试验OK;

更改轮询规则为wlc,权重为2,进行测试

用另一台linux机器curl测试,出现2次1,1次2,来回切换说明OK;

|

1

2

3

4

5

6

|

[root@localhost ~]

# curl 192.168.22.11

rs1rs1rs1

[root@localhost ~]

# curl 192.168.22.11

rs1rs1rs1

[root@localhost ~]

# curl 192.168.22.11

rs2rs2rs2

|

在dr机器上ipvsadm -ln可以查看,权重比,保持的链接比大概一样;

|

1

2

3

4

|

-> RemoteAddress:Port Forward Weight ActiveConn InActConn

TCP 192.168.22.11:80 wlc

-> 192.168.11.100:80 Masq 2 0 26

-> 192.168.11.101:80 Masq 1 0 13

|

3、LVS/DR 配置

DR模式中,director只负责分发,只有进入的流量,吞吐量会非常大;real server直接给用户提供数据,安全性会降低;

DR中的机器都需要配置公网ip,虚拟的ip每台机器都需要配置,用户请求的时候请求虚拟ip,返回的时候为轮询rs提供;

三台机器,每台机器只需要配置1个ip,vip是用脚本执行后会出现的,不用手动设置;

director(eth1:192.168.11.11 vip eth1:0 192.168.11.110)

real server1(eth1:192.168.11.100 vip lo:0: 192.168.11.110)

real server1(eth1:192.168.11.101 vip lo:0: 192.168.11.110)

Director 上 vim /usr/local/sbin/lvs_dr.sh //增加下面的内容

|

1

2

3

4

5

6

7

8

9

10

11

12

|

#! /bin/bash

echo

1 >

/proc/sys/net/ipv4/ip_forward

ipv=

/sbin/ipvsadm

vip=192.168.11.110

rs1=192.168.11.100

rs2=192.168.11.101

ifconfig

eth1:0 $vip broadcast $vip netmask 255.255.255.255 up

route add -host $vip dev eth1:0

$ipv -C

$ipv -A -t $vip:80 -s rr

$ipv -a -t $vip:80 -r $rs1:80 -g -w 1

$ipv -a -t $vip:80 -r $rs2:80 -g -w 1

|

两台rs上:vim /usr/local/sbin/lvs_dr_rs.sh

|

1

2

3

4

5

6

7

8

|

#! /bin/bash

vip=192.168.11.110

ifconfig

lo:0 $vip broadcast $vip netmask 255.255.255.255 up

route add -host $vip lo:0

echo

"1"

>

/proc/sys/net/ipv4/conf/lo/arp_ignore

echo

"2"

>

/proc/sys/net/ipv4/conf/lo/arp_announce

echo

"1"

>

/proc/sys/net/ipv4/conf/all/arp_ignore

echo

"2"

>

/proc/sys/net/ipv4/conf/all/arp_announce

|

然后director上执行: bash /usr/local/sbin/lvs_dr.sh

两台rs上执行: bash /usr/local/sbin/lvs_dr_rs.sh

执行完成后ifconfig可以显示虚拟ip地址;dr显示eth1:0,rs1、rs2显示lo:0;

|

1

2

3

4

5

6

7

8

|

eth1:0 Link encap:Ethernet HWaddr 00:0C:29:70:4E:58

inet addr:192.168.11.110 Bcast:192.168.11.110 Mask:255.255.255.255

UP BROADCAST RUNNING MULTICAST MTU:1500 Metric:1

Interrupt:18 Base address:0x2080

lo:0 Link encap:Local Loopback

inet addr:192.168.11.110 Mask:255.255.255.255

UP LOOPBACK RUNNING MTU:65536 Metric:1

|

ipvsadm -ln 列出规则

|

1

2

3

4

5

6

7

|

[root@dr ~]

# ipvsadm -ln

IP Virtual Server version 1.2.1 (size=4096)

Prot LocalAddress:Port Scheduler Flags

-> RemoteAddress:Port Forward Weight ActiveConn InActConn

TCP 192.168.11.110:80 rr

-> 192.168.11.100:80 Route 1 0 3

-> 192.168.11.101:80 Route 1 0 3

|

单独启动一台linux机器进行测试,浏览器测试有缓存不明显;

curl 192.168.11.110 进行测试,各出现1次说明rr轮询规则OK;

|

1

2

3

4

5

6

7

8

|

[root@localhost ~]

# curl 192.168.11.110

rs1rs1rs1

[root@localhost ~]

# curl 192.168.11.110

rs2rs2rs2

[root@localhost ~]

# curl 192.168.11.110

rs1rs1rs1

[root@localhost ~]

# curl 192.168.11.110

rs2rs2rs2

|

更改轮询算法为wrr,权重为2;然后执行文件,报错提示文件已存在;原因是/usr/local/sbin/lvs_dr.sh脚本文件里面已经up了eth1:0,所以需要在脚本里面增加:ifconfig eth1:0 down,之后就不会报错;

|

1

2

3

|

$ipv -A -t $vip:80 -s wrr

$ipv -a -t $vip:80 -r $rs1:80 -g -w 2

$ipv -a -t $vip:80 -r $rs2:80 -g -w 1

|

|

1

2

|

[root@dr ~]

# bash /usr/local/sbin/lvs_dr.sh

SIOCADDRT: 文件已存在

|

其中一台rs如果挂了之后,还是会轮询访问,所以会出现一会能打开一会打不开;

模拟,rs2停止nginx:/etc/init.d/nginx stop

使用curl测试,请求还是会发送到rs2上面,但是已经提示不能连接到主机;

|

1

2

3

4

5

6

|

[root@localhost ~]

# curl 192.168.11.110

rs1rs1rs1

[root@localhost ~]

# curl 192.168.11.110

rs1rs1rs1

[root@localhost ~]

# curl 192.168.11.110

curl: (7) couldn't connect to host

|

lvs本身不会剔除已经死掉的real server,所以需要结合keeplived;

本文转自 模范生 51CTO博客,原文链接:http://blog.51cto.com/mofansheng/1659585,如需转载请自行联系原作者